Genera vídeos de alto impacto con IA: todo lo que debes saber sobre Google Veo 3

Genera vídeos de alto impacto con IA: todo lo que debes saber sobre Google Veo 3

¿Tu negocio necesita una app?

Phishing: qué es, cómo detectarlo y cómo protegerse de los ciberataques

Optimización de Fichas de Productos: Cómo hacer que tu e-commerce se Posicione mejor en Google

Google Wallet ya disponible en Andorra: ¡paga con el móvil fácilmente!

Andornet, partner autorizado de SolarWinds

10 Beneficios del software a medida: optimiza tu empresa

¿Qué es el diseño web SEO?

Tendencias en diseño web para este 2024

Comercio electrónico, la herramienta imprescindible para hacer crecer tu negocio

5 beneficios del backup online para las empresas

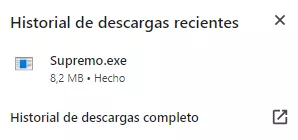

Haga clic en el archivo descargado.

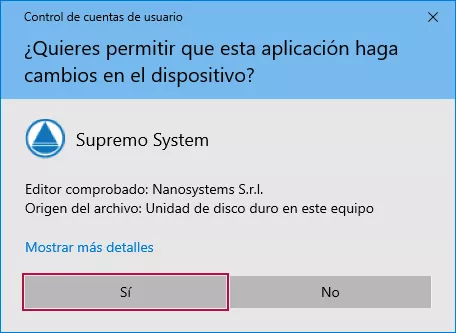

Haga clic en "Sí" para permitir la instalación.

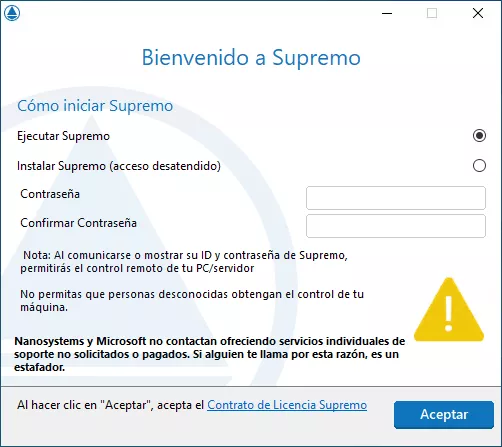

Haz clic en aceptar para conectarte con nosotros